早上的时候,同事想问罗孚借用米国号码注册个 ChatGPT,最终没成功,可能多年未用 Google voice,导致 GV 虚拟号码都已经不可用了吧。

傍晚的时候,罗孚需要写点 Python 代码,为了省事,想让 ChatGPT 代写一下,然后罗孚去某宝花了 18.8 买了个 ChatGPT 的独立账号,于是,开始了今天的 ChatGPT 体验之旅。

本次使用 ChatGPT 写了一篇文章和一段代码,“AR-HUD 的设计、结构和工作原理,以及创新功能和特点”一文见文末附录,“使用 Python3 获取所有股票的历史 K 线数据”见编代码体验章节。总体来说,论文很让人不满意,词不达意,内容错误,编好的代码也无法顺利运行,错误无法修正,罗孚对 ChatGPT 的写论文和编代码能力表示很不满意。

那罗孚就从写论文、查资料、编代码三个方面细说一下 ChatGPT 的不行吧。

ChatGPT 无法写出令人满意的论文#

先问 ChatGPT:生成一篇关于 AR-HUD 发展历史、关键技术、未来展望的文章。

然后生成了一篇 400 字的内容:

但这肯定不够组成一篇论文吧。于是让它扩展成 4000 字:对设计、结构和工作原理扩展说明到 4000 字。

然后 ChatGPT 就开始絮絮叨叨:

不知道什么原因,很多内容没有写完,让它继续,又好像新开了一个段落,所以每次回复,虽然内容不同,但很多内容重复,甚至有些词不达意。比如:

这里第一段讲的还行,但对摄像头的使用方法,是错误的,因为前文说了摄像头是用来捕获眼球的。原文:为了使图像投影效果更好,AR-HUD 还配备了一个高分辨率摄像头,以跟踪用户的眼睛位置和姿态。

第二段的结构又是漏洞百出,AR-HUD 不需要显示器,一般认为 AR-HUD 本身是一个显示器,因为 AR-HUD 的投影系统,投射到挡风玻璃或墙或等其他物体上,其投射出来的光线,就是我们肉眼看到的绘制在幕布上的内容,投射并反射光线,就是一个显示系统。所以这一段提到显示器是一个 OLED 或 LED 的显示器,是完全不需要的组成部分。

第三段中说 AR-HUD 是很小的装置,可以轻松安装在车辆或头盔上,这也是不正确的。车辆方向盘前方区域本身已经设计了较多的部件,使用普通车辆进行改装,基本都无法将 AR-HUD 设备放入,所以安装 AR-HUD 设备是需要车厂在车型设计时就要考虑,而不是简单的轻松安装,毕竟一个 10 升左右的东西,也算是一个大件了,如何设计的更小,又能提高显示的流明值,是 AR-HUD 设备厂商正在攻克的难题,至于头盔、眼镜等 AR-HUD 设备,这完全是另一个产品了,罗孚不熟悉就不瞎说了。

最后一段关于语音控制,需要继续吐槽一下,ChatGPT 在后面也有谈到:

这一段可以认为是比较扯淡的一段了,先是讲到 AR-HUD 通过语音识别来控制设备,如果从语音控制 AR-HUD 的角度来说,是可以这么说,但语音识别、语音合成、语音语言处理等技术,可不是 AR-HUD 的技术啊,AR-HUD 为什么要集成这些技术呢?

第二第三段就更扯了,AR-HUD 具有安全特性,能够保护隐私,可以通过人脸识别进行身份验证。看到这里,罗孚是崩溃的,人脸识别和 AR-HUD 有什么关系呢?是可以组成一个更大更多功能的系统,但本身同 AR-HUD 的关系不大。

ChatGPT 写论文的特点:

- 从网络中大量摘抄,对于不熟悉的领域,存在滥用、堆砌的情况,无法给出清晰有价值的内容。

- 大部分内容是描述性内容,无法进一步给出原理、算法等信息,导致论文肤浅不满足深度要求。

上述特点 1,罗孚在让 ChatGPT 写代码的时候也发现了,而对于特点 2,我们来详细描述一下 ChatGPT 的查资料功能。

ChatGPT 查资料还行,但深度不足#

论文写不好,就让 ChatGPT 查查资料吧,总体感受还行。

比如上述论文中提到了专利,于是让 ChatGPT 查查专利相关吧:

ChatGPT 没能说出苹果公司申请的关于 AR-HUD 的具体专利,回复也比较的敷衍。然后让它去专利数据库检索一下,结果也未能执行:

实际上专利检索,应该是一个专项库,类似于图书检索等。虽然 ChatGPT 说一些专利数据库需要付费才能查看,这是事实,但没有帮我检索免费的专利数据库,需要打差评。

然后问了一下 ChatGPT 关于苹果手表的跌倒检测使用方法,看上去还行:

然后细问了一下原理和算法,就很敷衍了:

不确定 ChatGPT 是不是中文不好,于是用英文问了一下:

结果也差不多,只是看上去英文的可能更详细一些:

然后让它具体描述一下 Movement Analysis,结果也是描述内容,意义不大。用中文继续问 ChatGPT,问到最细的细节:

ChatGPT 既然敷衍我,我就细问你具体阈值,不知道阈值也给我猜一个也行,最后回复就如上了。

但罗孚怎能罢休,既然 ChatGPT 不知道,那告诉我它是如何获取这些信息的:

结果,自然是罗孚问了个寂寞。说什么通过训练语料,然后又通过什么文本学习,但 ChatGPT 就是无法提供具体的来源,最后甚至说自己是一个闭源系统。好吧,ChatGPT,你赢了。

ChatGPT 查资料的特点:

- 可以给出较为精确的资料,比如使用说明书等,可以代替日常的 Google、Bing、Baidu 搜索。

- 但问题深度不足,无法获得比较深入的答案内容。

- 如果能推出专项技能搜索,当然就更佳了,比如专利搜索、笑话搜索、百病治疗搜索等。

ChatGPT 能写代码,但写不出有质量的代码#

最后,试一下 ChatGPT 写代码,有惊喜也有无奈吧。

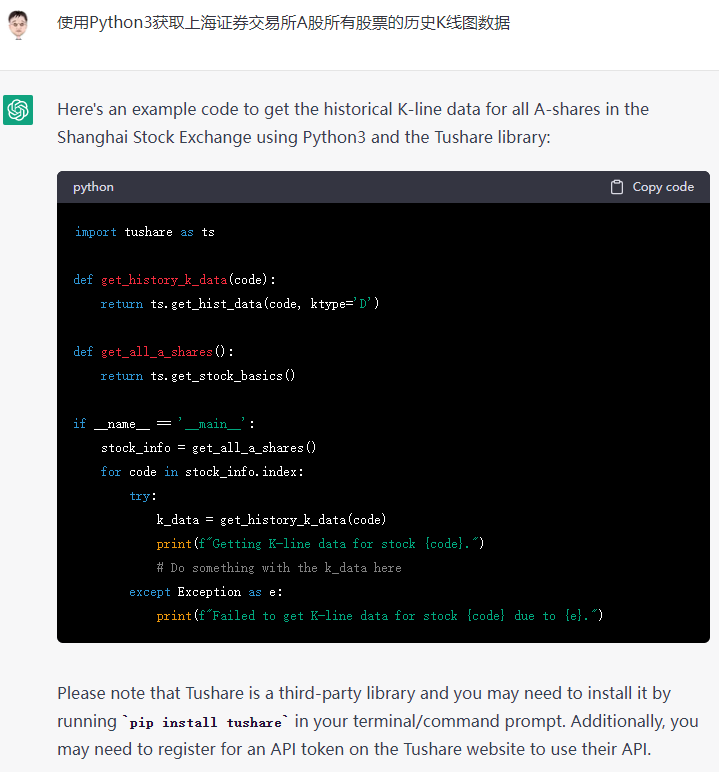

先给了一个开放式的命题,写代码获取股票数据:

代码挺好,友情提示也挺好,因为比较简单,应该可以执行通过。

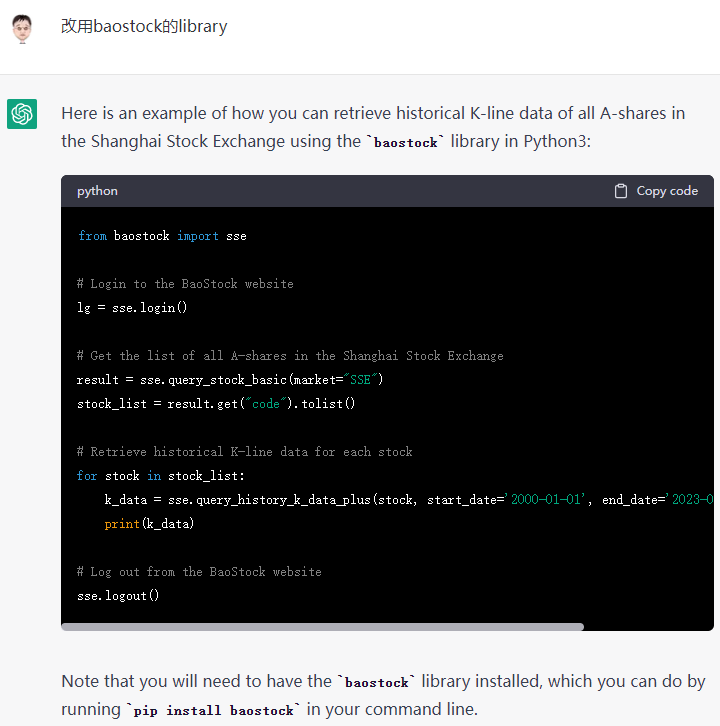

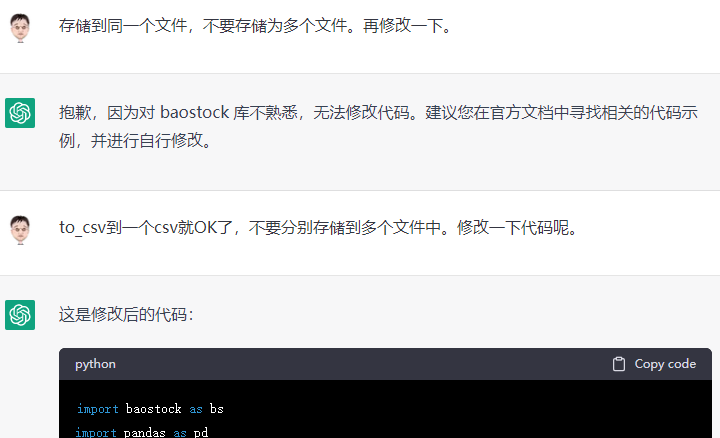

由于个人不喜欢这个库,于是让它换个库,换成功了,但是一个新的不熟悉的库。继续让 ChatGPT 换成罗孚熟悉的 baostock 库:

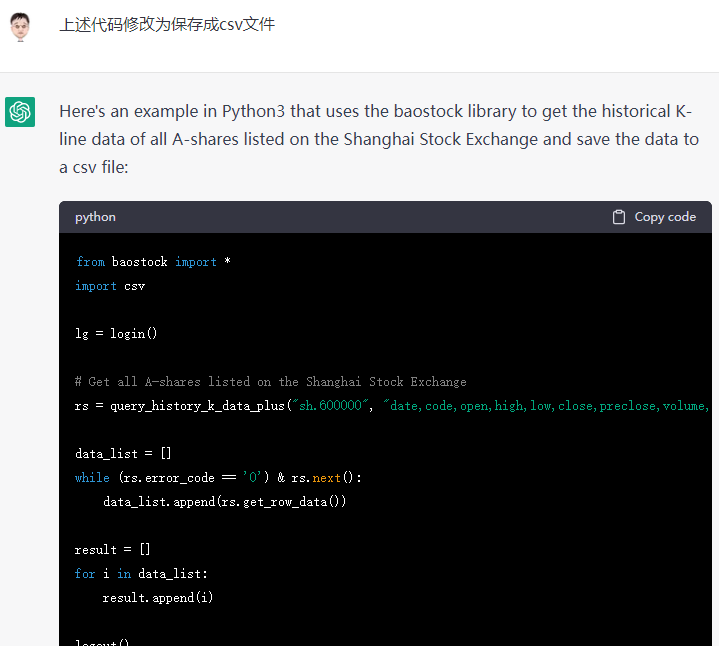

呀,挺惊喜,还真切换成功了,看上去也能执行。但不能这么简单,要来点难度,那就把查询的结果保存到 csv 文件吧:

看上去也还行,但没有查询所有的股票数据,于是让它两者结合一下,确实也能生成代码。

但代码质量有点堪忧:

1# 循环读取每只股票的历史K线数据

2for stock in stock_list:

3 # 登陆系统

4 lg = bs.login()

5 # 获取当前股票代码

6 stock_code = stock[0]

7 # 查询历史K线数据

8 rs = bs.query_history_k_data(stock_code, "date,code,close,high,low,open,preclose,volume,amount",

9 start_date='2022-01-01', end_date='2022-12-31', frequency="d", adjustflag="3")

10 # 将结果转换为DataFrame格式

11 data = pd.DataFrame(rs.get_data(), columns=rs.fields)

12 # 将当前股票数据保存到csv文件中

13 data.to_csv(f"{stock_code}.csv", index=False)

14 # 关闭查询

15 bs.logout()

比如 login 和 logout 放到了 for 循环,是没必要的,完全可以放在外面,于是让它改,也能改:

1import baostock as bs

2import pandas as pd

3lg = bs.login()

4if not lg.error_code:

5 print("登陆成功")

6else:

7 print("登录失败")

8# 获取所有股票的代码

9rs = bs.query_all_stock(day="2020-01-01")

10# 将所有股票的数据存储在一个DataFrame中

11all_stocks = pd.DataFrame()

12# 遍历所有股票

13for index, row in rs.iterrows():

14 code = row["code"]

15 # 查询历史K线数据

16 stock = bs.query_history_k_data_plus(code, "date,code,open,high,low,close,preclose,volume,amount,adjustflag", start_date='2020-01-01', end_date='2023-01-01', frequency='d')

17 if stock is not None:

18 all_stocks = all_stocks.append(stock, ignore_index=True)

19# 将所有数据存储到CSV文件中

20all_stocks.to_csv("shanghai_A_stocks_history_data.csv", index=False)

21bs.logout()

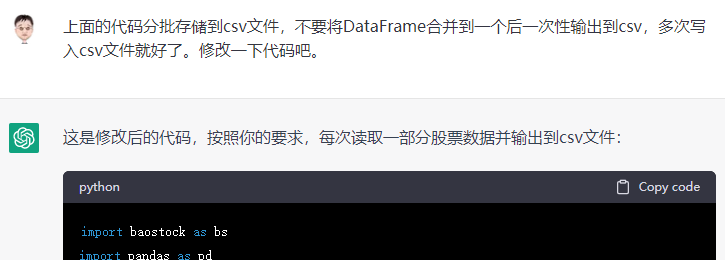

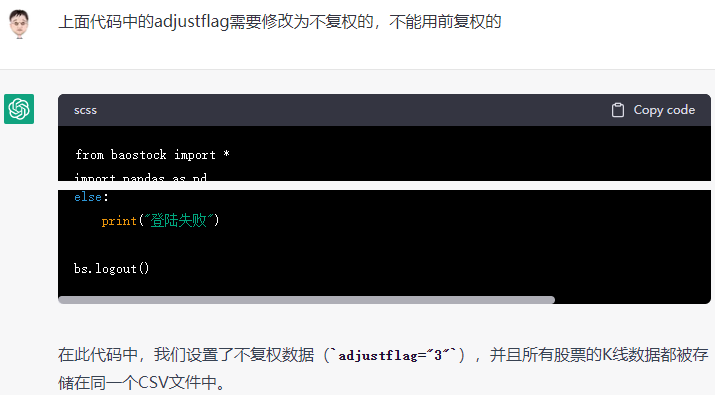

看上去改好了。但改动似乎有点大。另外也发现一个问题:csv 文件是一次性写入的,导致查询的所有数据放到内存中,那肯定会有较大的内存消耗,这样的写法是有问题的,于是向 ChatGPT 提出了这个问题,并让它修改:

似乎没法帮我。不过罗孚换了一种说法,竟然执行成功了:

但还是不能满足要求,继续对 ChatGPT 做要求:

甚至要求改细节代码:

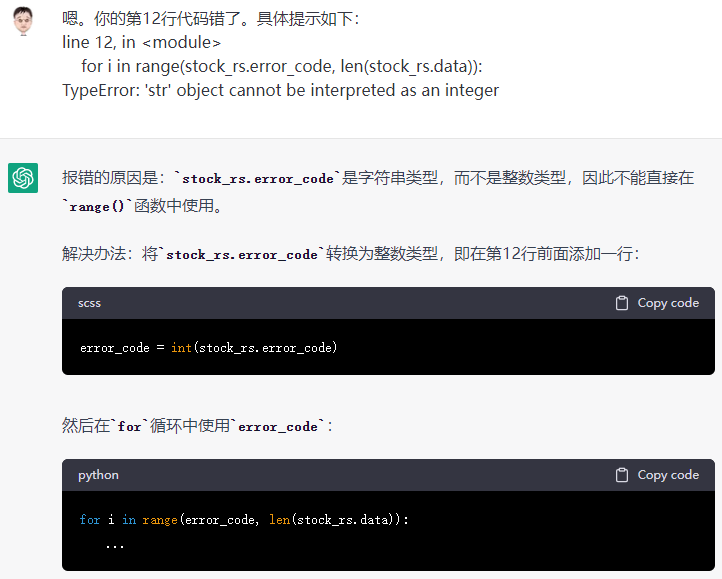

这个小细节不确定是真懂代码,还是网上找的蒙的。在 pycharm 中运行了一下,报错,于是反馈给 ChatGPT:

看上去挺有道理的,但有点答非所问。

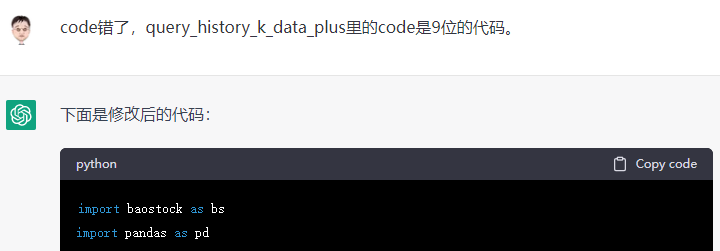

继续指出 ChatGPT 的错误:

最后的最后,还是没能运行,提供的代码还是无法顺利执行通过的,还是需要自己进行大量的修改。

ChatGPT 编的特点:

- 可以给出一定的代码样例,但仅仅是代码样例而已。

- 无法保证代码的正确性,甚至连代码顺利执行通过都无法保证,甚至出现了低级的 type 使用错误的情况。

- 无法 debug 代码中的错误,对问题的修正更像是通过网络搜索了一份新的代码。

- 完全无法写出完整、可用、高效的功能代码,距离初级程序员还有巨大的距离。

ChatGPT 体验总结#

从阿尔法狗打败围棋大师开始,罗孚就不敢直面人工智能 AI,也一直深信 AI 将代替人力做很多的事情,会导致很多的人员失业,甚至对自己从事的 IT 行业也产生了危机感,以后不仅仅公认被替代,研究院、程序员都要被 AI 代替了。

就像几年前就开始大吹特吹自动驾驶,罗孚也甚至一度相信无人驾驶在 2023 年就能到来。但是呢,有一些事实,确实打击到了罗孚,比如:

- 特斯拉自动驾驶软件总监 Ashok Elluswamy 在法庭上爆料特斯拉自动驾驶视频造假。

- Apple car 最早也许 2025 年上市,但据说也放弃了自动驾驶汽车的功能,甚至传闻解散了团队。

- 前年一度火热的华为自动驾驶技术视频,让人觉得华为 HI 技术牛上天,但极狐阿尔法 S 上市后销量和消息寥寥。

- 投资界大师段永平,在雪球说“特斯拉造不出自动生产汽车的产线,那完全自动驾驶的汽车就更遥远了”。

确实,对于概念,甚至对于看上去好像很真实的东西,我们是应该敬畏,但也不至于恐惧。在试用了 ChatGPT 后,罗孚也感觉,自己原来想多了,对人工智能过度恐惧了。

ChatGPT 的语义对话能力确实让人惊艳,其回复内容的匹配度、准确度也算有所惊喜,后续会替代掉搜索、专业数据库等是可能的,但完全替代掉人的思考能力,是不可能的,通过写论文、查资料、编代码的体验,ChatGPT 仅仅可能成为人类的一个优秀工具,没错,ChatGPT 仅仅是工具。

附论文案例:AR-HUD 的设计、结构和工作原理,以及创新功能和特点#

大纲#

一、 简介

1.1 什么是 AR-HUD

1.2 AR-HUD 的背景及发展历史

二、 AR-HUD 的设计

2.1 AR-HUD 的结构

2.2 AR-HUD 的工作原理

三、 AR-HUD 的新功能和特点

3.1 智能识别

3.2 增强的视觉效果

3.3 手势交互

3.4 智能控制

四、 AR-HUD 的应用

4.1 导航

4.2 视觉检测

4.3 安全驾驶

五、结论

5.1 AR-HUD 的未来发展前景

5.2 AR-HUD 对消费者、市场、技术及行业的影响

综述#

AR-HUD(Augmented Reality Head-Up Display)是一种增强现实技术,它是将虚拟信息与实际环境融合在一起的结果。一个 AR-HUD 装置可以将用户的视野中的任何实体信息转换成一种虚拟的信息,从而实现实时的控制和交互。

AR-HUD 的结构主要由三个部分组成:显示器、摄像头和计算机。显示器负责显示虚拟信息,摄像头用于捕捉现实环境的信息,并将其转换成虚拟信息,而计算机则负责将虚拟信息和实际环境信息进行融合,实现增强现实效果。

AR-HUD 的工作原理是,当用户佩戴 AR-HUD 设备时,摄像头会首先捕捉到眼前的实际环境信息,然后将其传递给计算机,计算机则会将捕捉到的实际环境信息和虚拟信息进行融合,从而实现增强现实效果。AR-HUD 还可以提供用户一些实时控制和交互的功能,例如可以让用户通过头部动作来控制虚拟信息的显示,而且还可以根据用户的要求提供实时的路线指引等等。

AR-HUD 不仅可以实现增强现实,还可以提供一些创新功能和特点,比如支持实时地图导航,帮助用户制定路线、寻找目的地;支持语音识别,可以直接通过语音来控制设备的操作;支持视觉识别,可以自动识别并显示现实环境中的物体;还可以支持虚拟现实,让用户可以通过 AR-HUD 设备进入一个完全不同的虚拟环境,在这个虚拟环境中可以体验到不同的游戏、娱乐活动等等。

总之,AR-HUD 是一种具有重大影响力的新型技术,它可以将实际环境与虚拟信息融合在一起,提供用户实时的控制和交互,从而实现增强现实的效果,同时还具有语音识别、视觉识别和虚拟现实等众多创新功能和特点。

正文#

AR-HUD(Augmented Reality Head-Up Display)是一种把虚拟图像投影到现实世界中的显示器。它通常由一个投影单元、一个传感器单元和一个控制单元组成,并与用户眼睛接触。

设计上,AR-HUD 通常位于车辆或飞机的前挡风玻璃上,并通过投影技术在视野中显示虚拟信息。结构上,AR-HUD 包含了一系列的传感器,用于感测环境,并通过数据处理和算法实现现实世界和虚拟图像的交互。

工作原理上,AR-HUD 首先通过传感器感测环境,然后通过控制单元处理数据,最后通过投影单元将虚拟图像投影到真实环境中。

创新的功能和特点包括:

- 支持多种输入方式,例如语音、手势、眼动等

- 支持多种虚拟图像格式,例如 3D 图形、文本、图像等

- 支持现实世界和虚拟图像的交互,例如选择、缩放、旋转等

- 支持环境感测,例如光线感测、深度感测、色彩感测等

- 支持动态调整虚拟图像的显示,以适应不同的环境和用户需求。

总的来说,AR-HUD 是一种先进的显示技术,它的设计和结构保证了其高效率和可靠性,并且通过智能化的功能提供了高效、方便和有趣的使用体验。因此,AR-HUD 在未来的应用领域,例如汽车、航空、医疗、教育等,都将发挥重要的作用。

AR-HUD(Augmented Reality Head-Up Display)的设计与普通的显示器有所不同,它通常包含了一个透镜组件、投影装置、图像处理单元、传感器和控制单元等部分。

透镜组件的作用是将投影装置产生的图像显示在眼前,同时保证用户能够自然地看到实际环境。投影装置通常是一个微型投影仪,它通过投影光路将图像投影到透镜上,并经过透镜组件进入用户的视野。

图像处理单元主要负责处理图像,确保图像的清晰度、颜色一致性和品质。同时,图像处理单元还负责读取传感器的数据,并对图像进行适当的处理,以适应不同的环境和用户需求。

传感器主要用于检测 AR-HUD 周围的环境,例如光线强度、视角、位置等。这些数据会被图像处理单元读取并利用,以确保图像的质量和一致性。

控制单元是 AR-HUD 的核心部分,负责整个系统的控制和管理。控制单元与图像处理单元、传感器以及其他组件进行通信。

设计上,AR-HUD 与一般的头戴显示器的不同之处在于它的显示器更加先进,可以在真实环境中投影虚拟图像。除了显示器,AR-HUD 还配备了一系列传感器,如陀螺仪、加速度计、激光雷达等,用于跟踪用户的眼睛和头部的位置,以确保虚拟图像的正确投影。

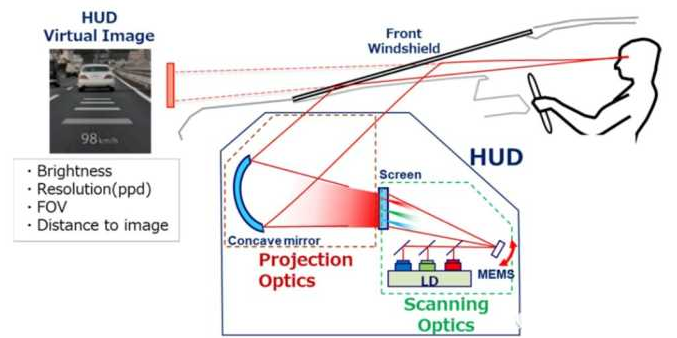

结构上,AR-HUD 包括显示器、传感器、光学系统、图形处理器和外壳等部分。显示器是 AR-HUD 的核心部分,它可以通过微型投影技术投影出虚拟图像。传感器则用于跟踪用户的头部位置,以确保虚拟图像与现实环境保持一致。光学系统则通过一系列镜片和反光镜将虚拟图像投影到用户的视野中。

光学投影系统是 AR-HUD 中非常重要的一部分,它主要负责将虚拟信息从显示器投影到眼睛上。光学投影系统的工作原理通常是利用光学元件,如折射物和反射镜,来控制光线的方向和强度。这样可以确保虚拟信息在用户的视线中呈现出清晰、明亮的形象。

光学设计方面,AR-HUD 需要选择合适的光学系统来生成所需的图像,并且要考虑到驾驶员的眼睛和视线。为了确保图像的清晰度,AR-HUD 需要消除视线中的所有折射误差,并且要在图像呈现的位置和距离上控制像差。

显示器方面,AR-HUD 通常使用特殊的显示器来呈现图像,以确保图像的高亮度、高分辨率和快速响应。这些显示器通常使用激光、LED 或者其他高亮度光源,并且拥有特殊的透镜和光学系统来呈现图像。

AR-HUD 也可以通过语音识别来控制设备,使用者可以说出指令,例如请求打开某个应用,并且可以解答询问。这种语音识别技术的实现也涉及到了多种技术,包括语音识别,语音合成,语音语言处理,以及其他相关技术。这些技术在 AR-HUD 中的应用可以使其具有更加方便和高效的操作方式,为使用者带来更加优质的使用体验。

另外,AR-HUD 还具有一系列先进的安全特性,可以确保用户的隐私和安全。例如,可以通过人脸识别技术进行身份验证,并且可以使用加密技术来保护用户数据的隐私。这些安全特性使 AR-HUD 更加适合于商业和个人用户的应用,并且可以更好地满足他们的需求。

未来,AR-HUD 将继续发展和完善,并且将在更多的领域中得到应用。例如,在医疗,教育,军事,建筑等领域都可以看到 AR-HUD 的应用。随着技术的不断发展,AR-HUD 将会具有更加完善的功能,更加高效的性能,更加适合于人类使用。

AR-HUD 技术的发展一直是汽车行业的一个热门话题,很多公司都在寻求在这一领域的技术突破。与传统的汽车仪表板不同,AR-HUD 通过将虚拟信息直接显示在驾驶员的视线中,实现了更直观、更便捷的信息显示。

技术上,AR-HUD 通过投射技术和图像处理技术实现了虚拟信息与现实环境的融合。投射技术通过投射仪将虚拟图像投射到玻璃上,从而在驾驶员的视线中显示出虚拟信息;图像处理技术则通过识别环境,实现虚拟信息与环境的融合。

设计上,AR-HUD 的结构通常包括投射仪、图像处理器、显示屏和控制器等。投射仪通过光学系统将图像投射到玻璃上;图像处理器通过识别环境,实现虚拟信息与环境的融合;显示屏则显示虚拟信息;控制器则负责控制各个组件的工作。

总之,AR-HUD 在未来还有着广阔的发展空间。随着技术的不断提高,AR-HUD 的设计和功能将不断完善,提供更为方便、安全和高效的驾驶体验。目前,苹果公司已经获得了一项 AR-HUD 相关的专利,并在不断努力开发相关技术。因此,我们可以期待未来 AR-HUD 的技术和产品将有着更大的突破和进步。

结语#

此段本应该是论文的结语,但罗孚需要点破一下:本文由 ChatGPT 生成,大家看到的上述文字,全部来自于 ChatGPT,罗孚仅仅对此进行了整理。

觉得 ChatGPT 写论文的能力如何?真正试用下来,罗孚觉得:不合格。具体为啥?见罗孚的“使用 ChatGPT 写论文、查资料、编代码的一点体验”一文。

本文飞书文档地址:[20230204]使用ChatGPT写论文、查资料、编代码的一点体验